DALL-E 2 et DALL-E 3 sont retirés le 12 mai 2026. ChatGPT Images 2.0, basé sur le modèle gpt-image-2, les remplace depuis le 21 avril. Ce guide couvre les cinq changements qui comptent vraiment pour la production de visuels marketing : la précision du rendu texte, le mode raisonnement, l’édition multi-tour, les batches de 8 images et les accès par tier. Comptez 15 minutes de lecture pour maîtriser ce qui a changé et adapter votre flux de travail.

Ce qui change avec gpt-image-2

La précision de rendu du texte atteint désormais environ 99 % au niveau des caractères, Latin, CJK (japonais, coréen, chinois), hindi et bengali inclus. C’est le changement le plus concret pour le marketing : une bannière avec un titre, un sous-titre et une URL pouvait sortir déformée à chaque tentative avec DALL-E 3. Ce n’est plus le cas.

Quatre autres points ont changé en même temps :

- Un mode Thinking qui raisonne la demande avant de générer (web search intégrée, planification de la composition)

- Une édition multi-tour sans dérive : modifier la couleur d’un bouton ne change plus le reste de la scène

- Des scènes à plus de 100 objets sans perte de cohérence

- Le maintien de la qualité quel que soit le style : photoréalisme, illustration, flat design

Ces cinq points expliquent le bond dans les classements de l’Image Arena leaderboard, selon les données publiées par MindwiredAI les 21-22 avril 2026, vérifiées contre l’annonce officielle OpenAI.

Instant Mode vs Thinking Mode : quelle différence pour votre équipe ?

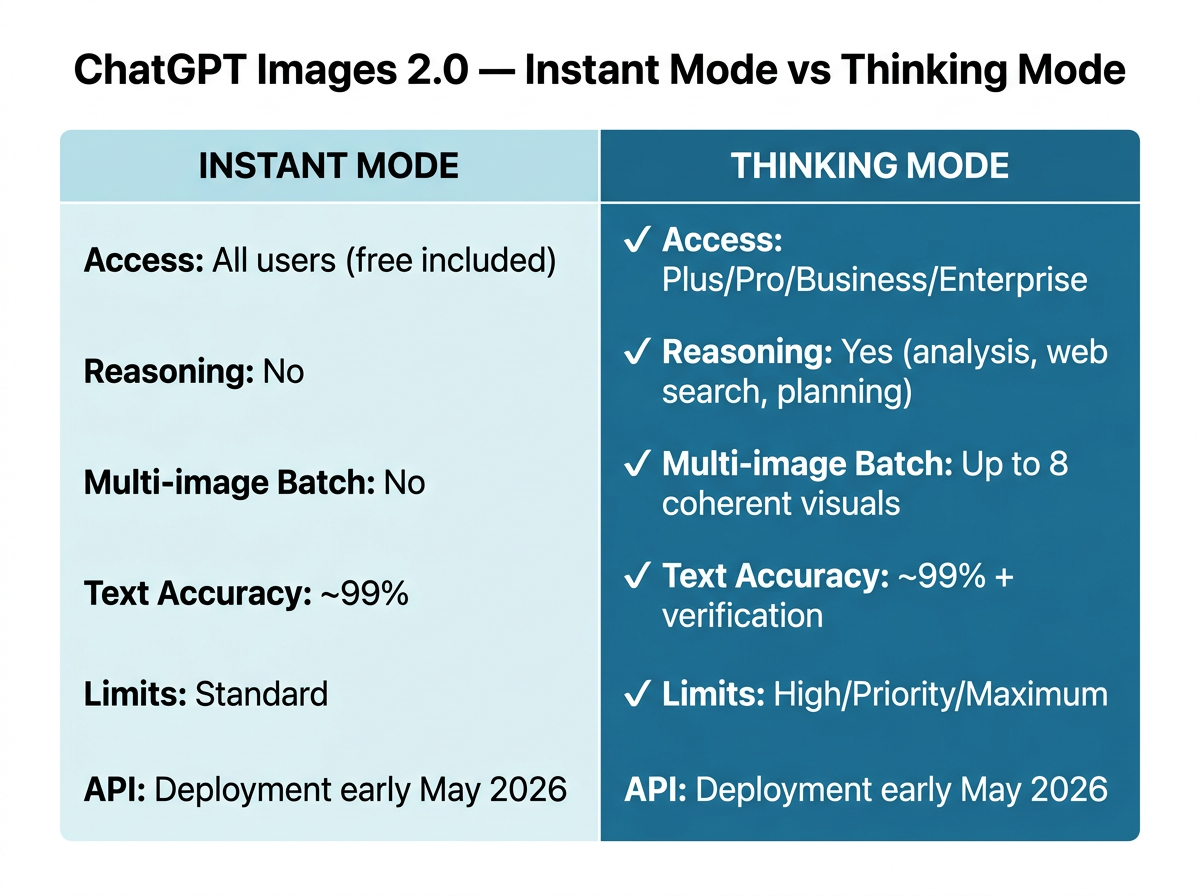

ChatGPT Images 2.0 fonctionne sur deux modes distincts. Savoir lequel vous avez vous évite de chercher des fonctionnalités qui ne sont pas dans votre tier.

| Critère | Instant Mode | Thinking Mode |

|---|---|---|

| Accès | Tous les utilisateurs ChatGPT (gratuit inclus) | Plus (20 $/mois), Pro (200 $/mois), Business, Enterprise |

| Raisonnement pré-génération | Non | Oui : analyse le brief, recherche sur le web, planifie la composition |

| Batch multi-images | Non | Oui : jusqu’à 8 visuels cohérents en une requête |

| Précision texte | ~99 % (Latin, CJK, Devanagari, Bengali) | ~99 % + vérification de cohérence post-génération |

| Limites de génération | Standard (non publiées) | Plus : élevées / Pro : prioritaires et maximales |

| API développeurs | Déploiement début mai 2026 | Déploiement début mai 2026 |

Attention : les abonnements Team Standard (25-30 $/utilisateur/mois) n’incluent pas automatiquement le Thinking Mode. Vérifiez les détails de votre contrat avant de planifier des workflows qui en dépendent.

Générer un visuel marketing avec Instant Mode

Pour produire une bannière réseau social avec texte intégré depuis l’interface ChatGPT web ou mobile, sans API, voici la procédure complète.

Ouvrez ChatGPT. Dans la barre de saisie, cliquez sur l’icône Images (accessible depuis le panneau latéral gauche dans la rubrique « Creative Studio »). Sélectionnez Générer une image.

Rédigez votre prompt en précisant ces quatre éléments dans l’ordre :

- Le format et les dimensions : « Bannière Instagram 1080×1080 px »

- La composition : « fond dégradé bleu marine vers violet, produit centré en bas »

- Le texte exact à afficher : « Texte visible : ‘Soldes -40%’, sous-titre : ‘Jusqu’au 15 mai’, URL en bas : ‘monsite.fr’ »

- Le style : « style épuré, typographie sans-serif blanche, ombres douces »

Cliquez sur Envoyer. L’image est générée en 10 à 30 secondes selon la charge serveur. Si le texte comporte une erreur, cliquez sur l’image, puis « Modifier » et précisez uniquement la correction : « Remplace ‘moniste.fr’ par ‘monsite.fr’, ne change rien d’autre. » L’édition multi-tour préserve la composition originale.

Pour télécharger : cliquez sur l’image générée, puis l’icône flèche vers le bas (download). Format PNG par défaut, jusqu’en 2K de résolution.

Utiliser le Thinking Mode pour les campagnes multi-visuels

Le Thinking Mode change le flux de travail pour les campagnes qui nécessitent une cohérence visuelle entre plusieurs assets. Plutôt que de générer un visuel, l’ajuster, le régénérer, vous soumettez un brief complet et obtenez jusqu’à 8 images cohérentes en une requête.

Activez le Thinking Mode en cliquant sur le toggle en haut à droite de la fenêtre de génération (visible uniquement sur les abonnements éligibles). Le curseur passe de « Instant » à « Thinking ».

Formulez votre brief comme vous le feriez avec un DA :

« Génère 6 visuels pour une campagne email de relance panier abandonné. Produit : montre connectée argentée sur fond blanc. Ton : premium, épuré. Textes à intégrer : (1) ‘Votre montre vous attend’, (2) ‘-15 % avant minuit’, (3) ‘Livraison offerte dès 150 €’, (4) ‘Nouveauté 2026’, (5) ‘En stock : 12 unités’, (6) ‘Offre valable jusqu’au 30/04’. Même composition de base pour les 6, textes différents. »

Le modèle commence par raisonner sur la demande (visible dans un panneau « Réflexion en cours »), recherche des références visuelles si nécessaire, puis génère les 6 images avec la même charte. Comptez 45 secondes à 3 minutes en Thinking Mode selon la complexité du brief.

Ce que les guides omettent : le Thinking Mode est particulièrement utile pour les briefs avec des contraintes contradictoires (« fond blanc ET texte blanc »). Le modèle les détecte pendant la phase de raisonnement et propose une solution avant de générer. En Instant Mode, il génère et échoue silencieusement.

Intégration API : ce qui change pour les développeurs (mai 2026)

L’API gpt-image-2 ouvre officiellement début mai 2026. DALL-E 2 et DALL-E 3 sont retirés le 12 mai 2026. Si votre pipeline appelle encore dall-e-3 dans ses requêtes API, vous avez moins de trois semaines pour migrer.

La tarification passe à un modèle à la consommation de tokens :

| Type de token | Prix par million | Usage |

|---|---|---|

| Image Input | 8 $/M tokens | Images de référence passées en input (style, produit) |

| Image Cached | 2 $/M tokens | Images de référence déjà traitées (cache) |

| Image Output | 30 $/M tokens | Images générées en sortie |

À 1024×1024, le coût par image varie selon la qualité choisie : environ 0,006 $ en qualité basse, 0,053 $ en qualité moyenne, 0,211 $ en qualité haute. Pour des campagnes à fort volume (milliers d’images/jour), la qualité moyenne est le point d’équilibre coût/rendu le plus courant.

Pour migrer depuis DALL-E 3, remplacez dans votre code :

- model: « dall-e-3 » par model: « gpt-image-2 »

- Le paramètre size accepte les mêmes valeurs (256×256, 512×512, 1024×1024, 1024×1792, 1792×1024)

- Le paramètre response_format reste inchangé (url ou b64_json)

Attention : la base de connaissances du modèle est arrêtée à décembre 2025. Les logos de marques ou références culturelles postérieures à cette date peuvent être inexacts. Passez vos assets de marque en image de référence (Image Input) pour les forcer.

Limites à connaître avant de basculer votre production

Trois limites sont à documenter avant d’intégrer gpt-image-2 dans un pipeline de production :

Cutoff décembre 2025 : le modèle ne connaît pas les événements, produits et logos lancés après décembre 2025. Pour un produit récent, passez systématiquement une image de référence en input plutôt que de décrire le produit en texte.

API non disponible avant mai 2026 : en avril, l’accès passe uniquement par l’interface web ChatGPT ou des proxies tiers (environ 0,01-0,03 $/image). Si vous avez un besoin d’automatisation immédiat, les proxies sont une option temporaire acceptable. Vérifiez les conditions d’utilisation de chaque fournisseur avant d’y envoyer des assets confidentiels.

Visages et personnes publiques : les restrictions de génération de visages réalistes restent en place, conformément aux règles d’utilisation d’OpenAI. Pour les campagnes qui nécessitent des personnages humains, le style illustration ou les modèles stock restent plus fiables dans les contextes réglementés (santé, finance, publicité pour enfants).

Ce que cela change pour votre budget visuel

Les équipes ayant intégré des outils de génération visuelle en production constatent des gains de productivité significatifs sur les assets répétitifs (variantes A/B, formats multi-réseaux, déclinaisons saisonnières). gpt-image-2 est le premier modèle grand public qui couvre la chaîne complète : idéation en prompt libre, texte précis dans l’image, formats finaux, batch cohérent sans configuration technique.

En pratique, les maquettes basse fidélité que vous envoyiez à un graphiste pour les affiner sont maintenant produisibles directement à une qualité intermédiaire. Ce ne sont pas des livrables finaux dans tous les cas : les chartes graphiques complexes, les retouches de peau et la post-production vidéo restent hors scope. Mais pour les assets de campagne email, les visuels de posts organiques, les bannières display standard et les variantes A/B, le pipeline change.

Les 77 % de marketeurs qui utilisent déjà ChatGPT (données Incremys 2026) avaient jusqu’ici un outil de génération d’image bloqué par le rendu texte. Ce verrou est levé. Définissez quels types d’assets migrent vers gpt-image-2 et lesquels restent dans des outils spécialisés comme Midjourney ou Adobe Firefly : la réponse dépend de vos contraintes de charte et de contrôle de marque.