Le 4 avril 2026 à 21h00 (heure de Paris), des centaines de milliers d’instances OpenClaw perdent l’accès à Claude via abonnement. L’argument officiel d’Anthropic tient en un chiffre : un abonnement Max à $200 par mois absorbait jusqu’à $5 000 de compute agent par jour, soit un ratio pouvant atteindre 25 pour 1 dans les cas les plus extrêmes. Ce que cet argument ne dit pas, c’est que la coupure intervient exactement 49 jours après que Peter Steinberger, créateur d’OpenClaw, a rejoint OpenAI. Et trois semaines après le lancement de Claude Dispatch le 17 mars, l’outil d’automatisation maison d’Anthropic. La chronologie ne prouve rien. Elle pose une question que les chiffres seuls ne résolvent pas.

OpenClaw en cinq mois : de Clawdbot à 247 000 étoiles GitHub

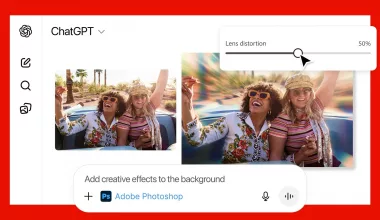

En novembre 2025, Peter Steinberger lance Clawdbot, renommé Moltbot le 27 janvier 2026 après une plainte de marque d’Anthropic, puis OpenClaw trois jours plus tard. Le principe : exploiter les abonnements Claude Pro pour faire tourner des agents autonomes en continu, sans passer par l’API payante à la consommation. L’adoption est rapide. En mars 2026, le dépôt GitHub dépasse 247 000 étoiles.

Au pic, OpenClaw représente jusqu’à 20% du volume total d’appels sur les serveurs d’Anthropic. Un outil non officiel, construit par un développeur indépendant, capte un cinquième de la capacité d’infrastructure d’une entreprise valorisée à $380 milliards depuis février 2026. Ce seul chiffre explique pourquoi la situation était intenable, quelle que soit la motivation d’Anthropic.

Le 14 février 2026, Steinberger annonce son départ chez OpenAI. Sam Altman précise qu’il y dirigera « la prochaine génération d’agents personnels » et qu’OpenClaw sera transféré vers une fondation open source avec le soutien d’OpenAI. À partir de là, tout ce qu’Anthropic fait avec OpenClaw sera lu à travers ce prisme.

L’argument officiel des coûts : solide mais daté

Boris Cherny, responsable de Claude Code chez Anthropic, a formulé la position officielle sans ambiguïté.

« Les abonnements n’ont pas été conçus pour les patterns d’usage des outils tiers. La capacité est une ressource que nous gérons de façon réfléchie, et nous priorisons nos clients qui utilisent nos produits et notre API. » Boris Cherny, Head of Claude Code, Anthropic

L’argument tient sur le fond. Un abonnement Claude Max à $200 par mois cible un usage conversationnel humain, quelques dizaines d’échanges par jour. Un agent OpenClaw tournant en continu consomme entre $1 000 et $5 000 de compute en une seule journée, selon The Next Web (avril 2026). À $15 par million de tokens en sortie pour Claude Sonnet 4.6, les sessions agents non optimisées atteignent rapidement des volumes incompatibles avec tout abonnement fixe.

Anthropic signale aussi un détail technique peu relayé : ses outils natifs comme Claude Code sont optimisés pour maximiser les taux de prompt cache hit, c’est-à-dire la réutilisation de texte déjà traité pour réduire la consommation de compute. Les outils tiers n’ont pas accès à ces optimisations, ce qui gonfle mécaniquement leur empreinte sur l’infrastructure. Les produits maison jouent avec des règles avantageuses que les tiers ne peuvent pas répliquer.

La chronologie qui dérange

Les coûts expliquent la décision. Ils n’expliquent pas le calendrier. OpenClaw a fonctionné de novembre 2025 à avril 2026 sans aucune sanction d’Anthropic. La tolérance a duré exactement aussi longtemps que son créateur était indépendant.

La séquence est précise. 14 février 2026 : Steinberger rejoint OpenAI. 20 février : Anthropic met à jour ses CGU pour interdire explicitement l’usage des tokens OAuth d’abonnement dans tout outil tiers. Cette mise à jour passe inaperçue. 17 mars : Anthropic lance Claude Dispatch en research preview, son propre outil d’automatisation agentique. 4 avril : la coupure prend effet.

OpenAI a immédiatement utilisé cet événement comme levier commercial. En se présentant comme un partenaire « ecosystem-friendly », la société de Sam Altman cible activement les développeurs frustrés. Le départ de Steinberger a transformé son ancien projet en vecteur d’acquisition involontaire : des centaines de milliers d’utilisateurs mécontents, un fondateur déjà dans la maison d’en face, un récit de guerre des plateformes prêt à l’emploi.

Anthropic aurait-il agi pareil si Steinberger était resté indépendant ? Impossible à vérifier. Ce qui est factuel : lancer son propre outil concurrent trois jours avant de couper les alternatives tierces, c’est une séquence que l’industrie tech connaît bien. Apple l’a fait avec les apps natives. Google aussi avec Android. Ça n’implique pas forcément de mauvaise foi. Ça implique une stratégie de plateforme.

Impact sur les utilisateurs et alternatives disponibles

Pour les utilisateurs, 2 options. Basculer sur l’API directe Anthropic, facturée à la consommation : $3 par million de tokens en entrée et $15 en sortie pour Claude Sonnet 4.6, $5 en entrée et $25 en sortie pour Claude Opus 4.6. Pour des workflows agents intensifs, la facture mensuelle peut atteindre plusieurs centaines de dollars, soit une multiplication par 10 à 50 par rapport à l’abonnement précédent. Ou utiliser le bundle « extra usage » avec une remise allant jusqu’à 30%.

Anthropic offre un crédit unique équivalent à un mois d’abonnement, utilisable jusqu’au 17 avril 2026. Passé cette date, plus d’exception pour les accès via abonnement fixe.

Une partie des développeurs ne migre vers aucune option Anthropic. Certains se tournent vers Gemma 4 de Google DeepMind ou d’autres modèles open source, pour ne plus dépendre d’une API dont les conditions peuvent changer en 48 heures. C’est probablement la conséquence qu’Anthropic redoutait le plus.

Ce que cette affaire révèle sur la structure de l’IA en 2026

OpenClaw n’est pas un cas isolé. Les plateformes d’IA ont besoin de développeurs tiers pour bâtir l’écosystème qui justifie leur valorisation. Mais ces mêmes développeurs deviennent gênants dès qu’ils atteignent une taille critique. C’est le paradoxe de toute plateforme qui réussit : elle attire exactement les gens qu’elle devra éventuellement contraindre.

La réponse habituelle dans la tech consiste à garder les couches les plus rentables en interne et à tolérer l’écosystème tiers sur les marges. Couper OpenClaw tout en lançant Claude Dispatch suit exactement ce schéma.

Pour les développeurs qui ont construit sur des abonnements Claude, le message est lisible. Construire sur la plateforme d’un autre, c’est louer un terrain dont le propriétaire peut modifier les règles à tout moment. Ce qui reste ouvert : pourquoi 135 000 utilisateurs avaient-ils choisi un outil tiers non officiel plutôt que les solutions natives d’Anthropic ? Cette préférence dit quelque chose du produit qu’Anthropic n’avait pas encore construit.

Pourquoi Anthropic a-t-il coupé l’accès à Claude pour OpenClaw ?

Anthropic invoque un déséquilibre économique documenté : un abonnement Max à $200 par mois permettait de consommer entre $1 000 et $5 000 de compute agent par jour. Les CGU, mises à jour le 20 février 2026, interdisent désormais explicitement l’usage des tokens OAuth d’abonnement dans tout outil tiers.

Quelles alternatives ont les utilisateurs d’OpenClaw après la coupure ?

2 options : le système « extra usage » d’Anthropic avec une remise allant jusqu’à 30% ou une clé API directe facturée au token. Un crédit unique équivalent à un mois d’abonnement est disponible jusqu’au 17 avril 2026. Au-delà, la facturation à la consommation devient la seule voie.

Quel est le lien entre la coupure OpenClaw et OpenAI ?

Peter Steinberger, créateur d’OpenClaw, a rejoint OpenAI le 14 février 2026. La coupure d’Anthropic a pris effet 49 jours plus tard. OpenAI a immédiatement utilisé cette décision comme levier commercial pour attirer les développeurs Claude mécontents, en se positionnant comme un partenaire plus ouvert aux outils tiers.